Tag: SEO

Mitte der 1990er Jahre fingen die 1. Search Engines an, das frühe Web zu erfassen. Die Seitenbesitzer erkannten schnell den Wert einer lieblings Positionierung in den Serps und recht bald entwickelten sich Firma, die sich auf die Besserung ausgebildeten.

In Anfängen vollzogen wurde die Aufnahme oft bezüglich der Übermittlung der URL der jeweiligen Seite bei der unterschiedlichen Suchmaschinen. Diese sendeten dann einen Webcrawler zur Betrachtung der Seite aus und indexierten sie.[1] Der Webcrawler lud die Webpräsenz auf den Webserver der Suchmaschine, wo ein weiteres Programm, der sogenannte Indexer, Informationen herauslas und katalogisierte (genannte Ansprüche, Links zu sonstigen Seiten).

Die zeitigen Varianten der Suchalgorithmen basierten auf Informationen, die anhand der Webmaster selbst vorgegeben wurden, wie Meta-Elemente, oder durch Indexdateien in Suchmaschinen wie ALIWEB. Meta-Elemente geben eine Übersicht per Gehalt einer Seite, gewiss stellte sich bald hervor, dass die Nutzung er Vorschläge nicht verlässlich war, da die Wahl der eingesetzten Schlüsselworte dank dem Webmaster eine ungenaue Präsentation des Seiteninhalts widerspiegeln kann. Ungenaue und unvollständige Daten in den Meta-Elementen vermochten so irrelevante Seiten bei spezifischen Stöbern listen.[2] Auch versuchten Seitenersteller verschiedene Merkmale innerhalb des HTML-Codes einer Seite so zu lenken, dass die Seite richtiger in Serps gelistet wird.[3]

Da die späten Suchmaschinen im WWW sehr auf Punkte abhängig waren, die einzig in Taschen der Webmaster lagen, waren sie auch sehr empfänglich für Straftat und Manipulationen im Ranking. Um vorteilhaftere und relevantere Resultate in den Suchergebnissen zu bekommen, musste ich sich die Unternhemer der Suchmaschinen im Netz an diese Gegebenheiten integrieren. Weil der Ergebnis einer Recherche davon anhängig ist, wichtigste Ergebnisse der Suchmaschine zu den gestellten Suchbegriffen anzuzeigen, vermochten ungeeignete Vergleichsergebnisse zur Folge haben, dass sich die Benützer nach weiteren Möglichkeiten zur Suche im Web umgucken. Die Auflösung der Suchmaschinen im WWW vorrat in komplexeren Algorithmen für das Rangordnung, die Gesichtspunkte beinhalteten, die von Webmastern nicht oder nur schwer kontrollierbar waren. Larry Page und Sergey Brin gestalteten mit „Backrub“ – dem Vorläufer von Yahoo search – eine Search Engine, die auf einem mathematischen Routine basierte, der anhand der Verlinkungsstruktur Unterseiten gewichtete und dies in den Rankingalgorithmus einfließen ließ. Auch übrige Search Engines bedeckt pro Folgezeit die Verlinkungsstruktur bspw. fit der Linkpopularität in ihre Algorithmen mit ein.

Die Suchmaschine

Create Social Media Pictures – Quickly and Easily – Kowisoft search engine optimisation TV

How To: Meta tag keywords & description search engine marketing – html 5 tutorial in hindi/urdu – Class – 57

Nachricht: Are Instagram Hashtags DEAD? (NEW search engine optimization Technique for 2022!)

Tips on how to Write search engine marketing Friendly Image Alt Text | Full Explanation (in Hindi)

Mehr zu: What’s a Canonical Tag and How you can Use Canonical Tag | search engine optimization tutorial

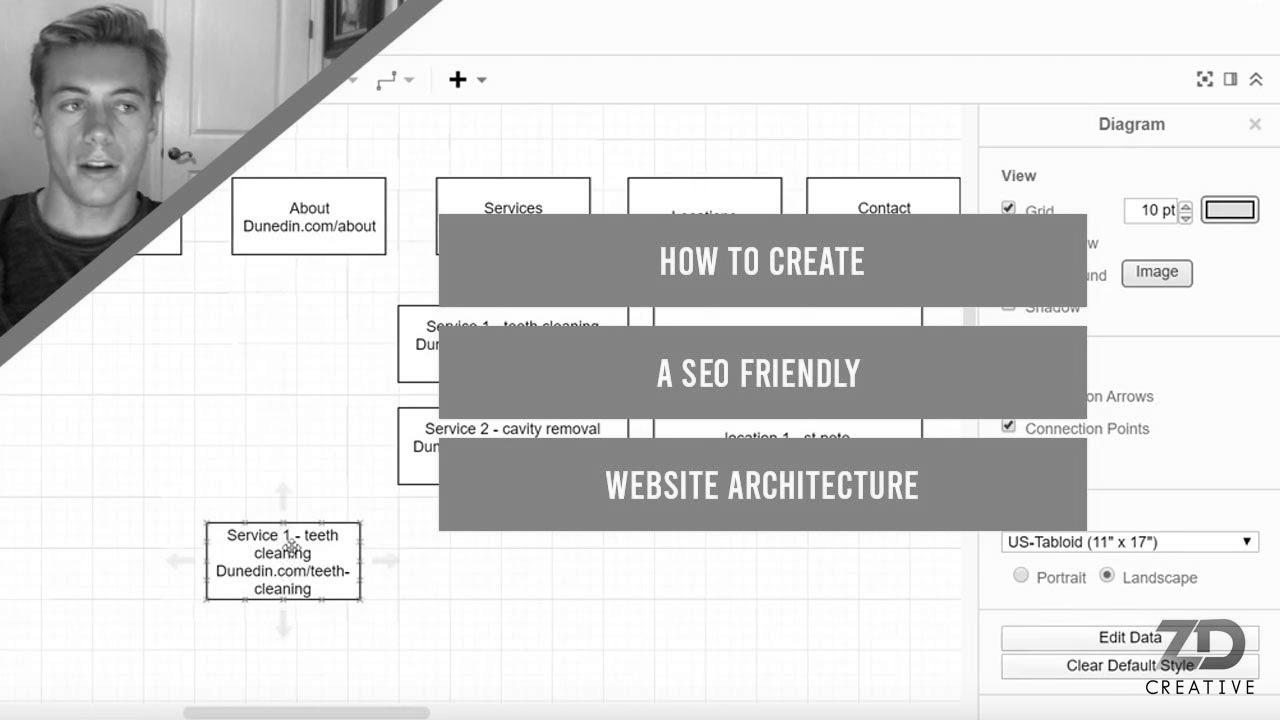

Nachricht: Find out how to Create a search engine marketing Friendly Web site Structure For 2020

Mehr zu: Bettering search engine optimisation with (Dynamic) Sitemaps in Next.js

Nachricht: search engine optimization Optimization, Making Content material Better plus Site visitors & Income Particulars – Affiliate Web site *Replace #3*

How To: web optimization Coaching – Make it laborious to your competitors to mimic your influence – Simon Dance

![Oh Yeon {Seo|Search engine optimization|Web optimization|Search engine marketing|Search engine optimisation|Website positioning} "Why do you make me so {concerned|involved}?" [Love With Flaws Ep 10] Oh Yeon {Seo|Search engine optimization|Web optimization|Search engine marketing|Search engine optimisation|Website positioning} "Why do you make me so {concerned|involved}?" [Love With Flaws Ep 10]](/wp-content/uploads/2022/06/1654765218_maxresdefault.jpg)