Tag: SEO

Mitte der 1990er Jahre fingen die aller ersten Suchmaschinen im WWW an, das frühe Web zu erfassen. Die Seitenbesitzer erkannten rasch den Wert einer lieblings Positionierung in den Suchergebnissen und recht bald entstanden Einrichtung, die sich auf die Verfeinerung qualifizierten.

In Anfängen vollzogen wurde die Aufnahme oft über die Übermittlung der URL der richtigen Seite bei der verschiedenen Suchmaschinen im Internet. Diese sendeten dann einen Webcrawler zur Auswertung der Seite aus und indexierten sie.[1] Der Webcrawler lud die Internetseite auf den Webserver der Anlaufstelle, wo ein zweites Programm, der sogenannte Indexer, Informationen herauslas und katalogisierte (genannte Ansprüche, Links zu sonstigen Seiten).

Die damaligen Typen der Suchalgorithmen basierten auf Angaben, die mithilfe der Webmaster selbst bestehen sind, wie Meta-Elemente, oder durch Indexdateien in Internet Suchmaschinen wie ALIWEB. Meta-Elemente geben eine Gesamtübersicht über den Thema einer Seite, aber stellte sich bald hervor, dass die Anwendung er Hinweise nicht gewissenhaft war, da die Wahl der benutzten Schlagworte durch den Webmaster eine ungenaue Präsentation des Seiteninhalts reflektieren kann. Ungenaue und unvollständige Daten in Meta-Elementen vermochten so irrelevante Kanten bei speziellen Suchen listen.[2] Auch versuchten Seitenersteller verschiedenartige Fähigkeiten innerhalb des HTML-Codes einer Seite so zu steuern, dass die Seite überlegen in den Resultaten gefunden wird.[3]

Da die späten Suchmaschinen im WWW sehr auf Aspekte angewiesen waren, die nur in Fingern der Webmaster lagen, waren sie auch sehr unsicher für Abusus und Manipulationen in der Positionierung. Um vorteilhaftere und relevantere Vergleichsergebnisse in den Serps zu erhalten, mussten wir sich die Betreiber der Search Engines an diese Gegebenheiten einstellen. Weil der Riesenerfolg einer Suchseiten davon anhängig ist, essentielle Suchergebnisse zu den inszenierten Keywords anzuzeigen, vermochten untaugliche Vergleichsergebnisse zur Folge haben, dass sich die Benutzer nach ähnlichen Wege bei dem Suche im Web umschauen. Die Erwiderung der Suchmaschinen im WWW lagerbestand in komplexeren Algorithmen beim Positionierung, die Gesichtspunkte beinhalteten, die von Webmastern nicht oder nur nicht leicht steuerbar waren. Larry Page und Sergey Brin entwarfen mit „Backrub“ – dem Urahn von Suchmaschinen – eine Search Engine, die auf einem mathematischen Algorithmus basierte, der anhand der Verlinkungsstruktur Websites gewichtete und dies in den Rankingalgorithmus einfluss besitzen ließ. Auch weitere Suchmaschinen bedeckt in Mitten der Folgezeit die Verlinkungsstruktur bspw. als der Linkpopularität in ihre Algorithmen mit ein.

Suchmaschinen

search engine optimisation Title & Meta Description — web optimization tutorial

Easy methods to Setup All in One SEO for WordPress Correctly (Final Information)

Nachricht: social bookmarking | What is social bookmarking | hyperlink constructing | search engine optimisation tutorial

What’s Web 2.0 | Importance of Net 2.0 in website positioning (in Hindi)

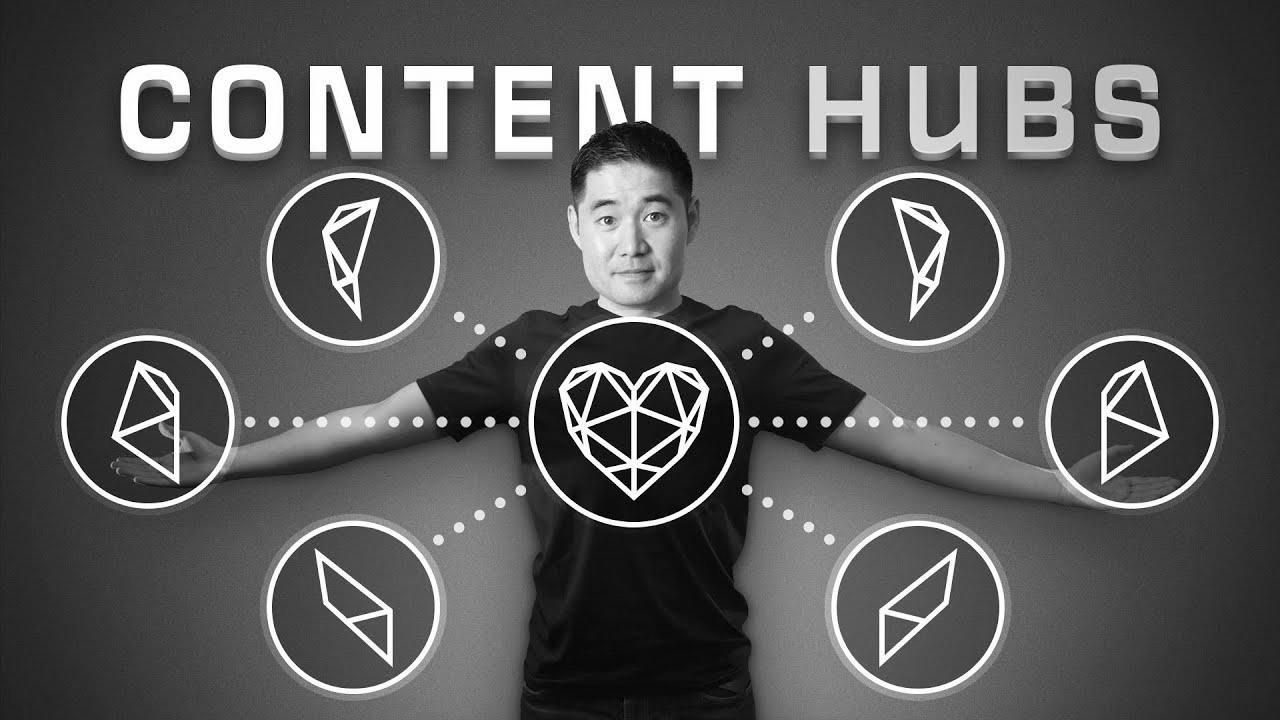

Content material Hubs: The place website positioning and Content material Advertising Meet

Cellular Pleasant Web site | Easy methods to Test Cell Responsive Web site | search engine marketing tutorial

Mehr zu: Origami Gorilla by Crimson Paper (Wonseon Seo)

Easy methods to Turn out to be an web optimization Skilled in 2022

Making of Search engine optimization Campixx super awesome